Simulaciones de nuestra metodología GOS™ aplicadas a entornos de riesgo crítico.

Un retailer paneuropeo utilizaba algoritmos de personalización sin un marco de trazabilidad de datos definido. La falta de control sobre las variables de segmentación dificultaba la acreditación del consentimiento, exponiendo a la empresa a fricciones con el GDPR y la EU AI Act.

Implementamos un sistema de gobernanza que audita en tiempo real el flujo de datos. La plataforma introduce mecanismos de anonimización dinámica y documenta automáticamente la lógica de decisión, facilitando la transparencia técnica exigida por el regulador.

Una fintech empleaba un modelo de scoring crediticio (clasificado como Alto Riesgo bajo la EU AI Act) sin métricas de equidad documentadas. La naturaleza "Caja Negra" del modelo impedía explicar los rechazos de crédito, generando vulnerabilidad ante auditorías de sesgo.

Desplegamos la metodología GOS™ para instrumentar el modelo. Implementamos métricas de disparidad (Fairness Metrics), módulos de explicabilidad (XAI) y un registro inmutable (Audit Trail) que permite justificar técnicamente cada denegación de crédito

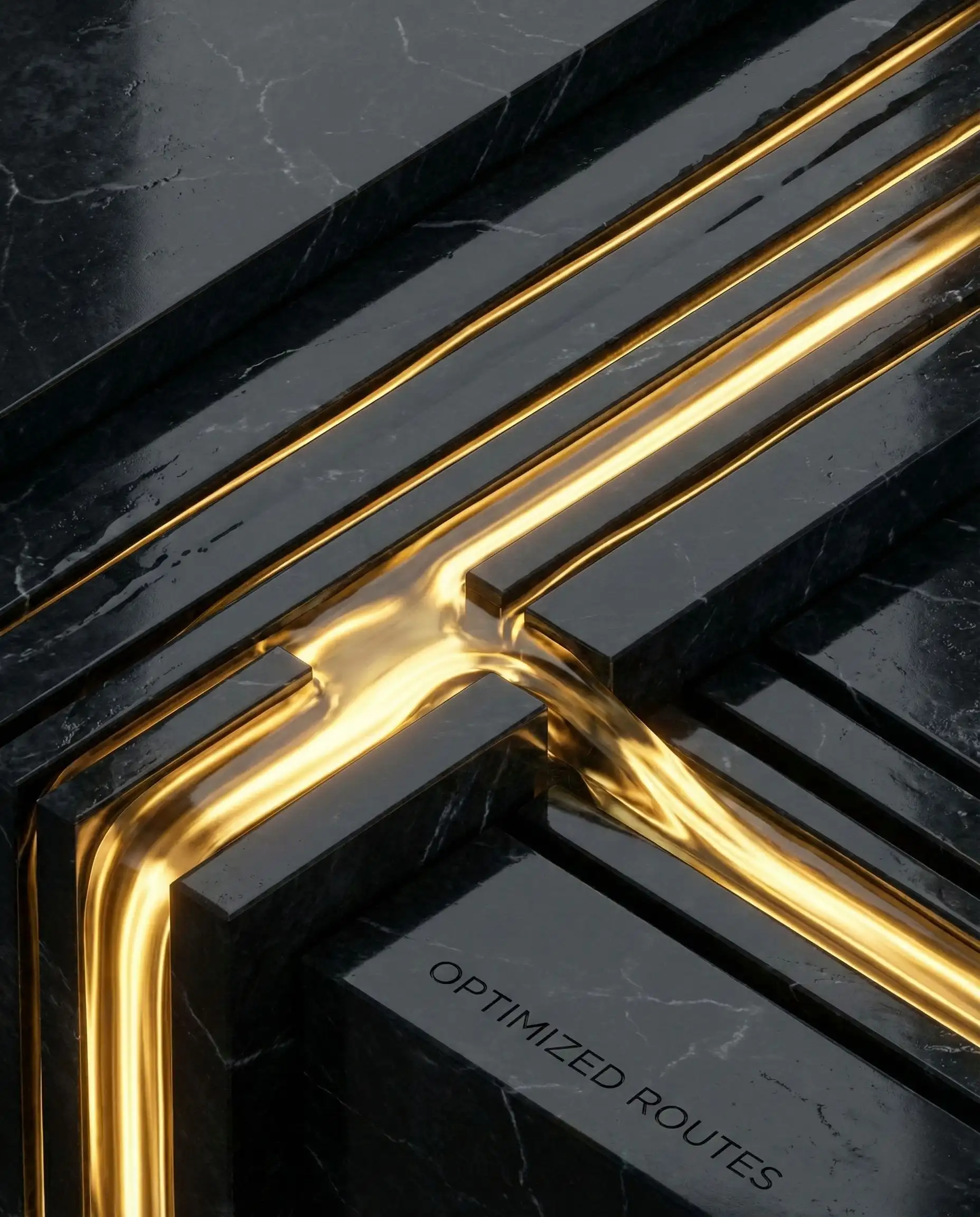

Una empresa de transporte dependía de un sistema automatizado de rutas sin protocolos de intervención manual formalizados. Al tratarse de infraestructura crítica, la ausencia de supervisión humana estructurada generaba una brecha de conformidad con el Artículo 14 de la AI Act.

Se integró una capa de control "Human-in-the-Loop" obligatorio. El sistema ahora congela decisiones anómalas y exige validación manual explícita para continuar, registrando la identidad del operador y la justificación del cambio para asegurar la cadena de responsabilidad.